使用KTransformer部署DeepSeekR1-671B满血量化版+ OpenwebUI 及多GPU(多卡)适配教程(Ubuntu+256G+4090+Intel)

ktransformers 是针对预算低但是想跑 671B Deepseek推出的框架 ,是基于显卡 + CPU 混合推理方案。官方使用双 Xeon ® Gold 6454S(共 64 核)、1TB-D5 内存和 RTX 4090 24GB,实现 671B 4-bit 量化版每秒 13.69 个词令生成速度。ktransformers 采用 Intel AMX 指令扩展,prefill 速度提升明显。

我的环境:Intel 61332(40C)+ 256G D4 + 4090D4 + 2T SSD + 16T HDD Ubuntu22.04 CUDA12.6 Python3.11

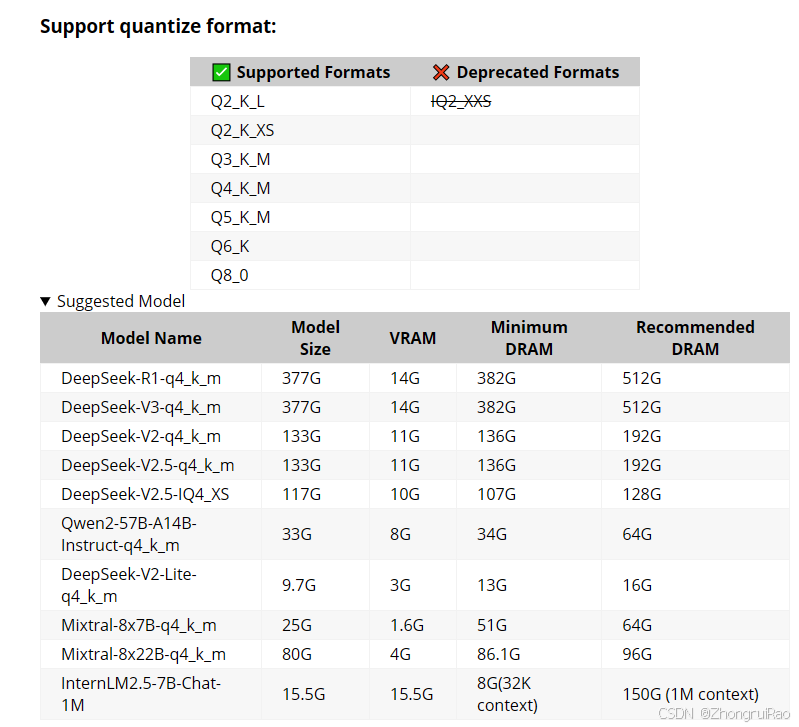

注:截止25.2.21,官方目前支持的模型如下,

其他版本装上去会乱码,我后面用的DeepSeek-R1-Q2_K_XS,读者需要根据最新版本的支持情况进行修改

1.预准备

具体步骤见 https://kvcache-ai.github.io/ktransformers/index.html

这里简单说一下:

首先需要CUDA12.1及以上,V0.3好像要12.5,尽量装最新吧

1.添加CUDA环境变量

vim ~/.bashrc ,末尾添加

# Adding CUDA to PATH

if [ -d "/usr/local/cuda/bin" ]; then

export PATH=$PATH:/usr/local/cuda/bin

fi

if [ -d "/usr/local/cuda/lib64" ]; then

export LD_LIBRARY_PATH=$LD_LIBRARY_PATH:/usr/local/cuda/lib64

# Or you can add it to /etc/ld.so.conf and run ldconfig as root:

# echo "/usr/local/cuda-12.x/lib64" | sudo tee -a /etc/ld.so.conf

# sudo ldconfig

fi

if [ -d "/usr/local/cuda" ]; then

export CUDA_PATH=$CUDA_PATH:/usr/local/cuda

fi

然后wq保存,退出

2.安装编译链

sudo apt-get update

sudo apt-get install build-essential cmake ninja-build

3.创建conda环境

conda安装教程自己去找一下,网上很多

conda create --name ktransformers python=3.11

conda activate ktra